Разговоры о том, как будет регулироваться деятельность ИИ, закончились — законы вступили в силу, а компании по всему миру сталкиваются с правовыми последствиями. Рассказываем, какие законы об ИИ действуют в 2026 году, что они регулируют и как это меняет индустрию.

Правовое регулирование в Европейском Союзе

В Евросоюзе принят и вступает в силу EU AI Act (Закон Евросоюза об ИИ) — закон, который регулирует разработку, использование и контроль ИИ. Его внедряют поэтапно, полностью его реализуют к 2026–2027 годам.

По нему компании должны оценивать риски и вводить четкие правила, чтобы эти проблемы предотвратить и обезопасить работу. По закону, нужна классификация рисков ИИ по категориям:

- Недопустимый риск — запрещенные приложения.

- Высокий риск — ИИ, которые используют в здравоохранении и образовании.

- Низкий риск — неопасные системы, к которым предъявляют минимальные требования.

Если платформа считается опасной, нужно проверить, не ошибается ли она, не предвзята ли, не взломают ли ее. Иначе использовать такую систему нельзя.

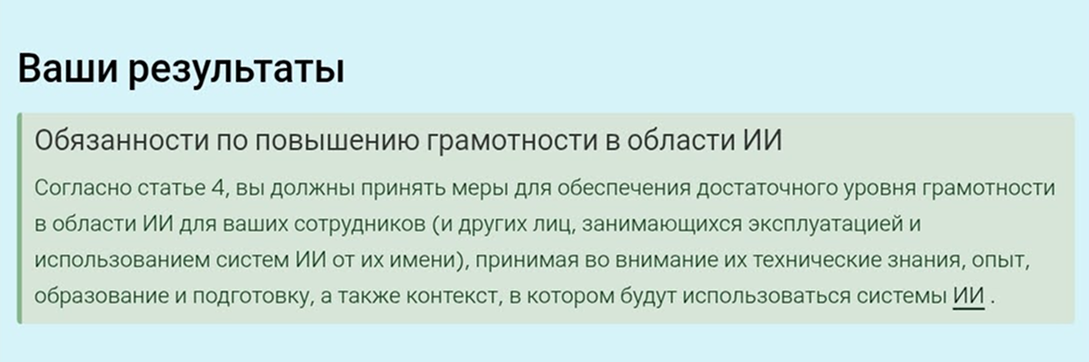

На сайте Закона ЕС об искусственном интеллекте есть тест. В зависимости от того, разработчик вы или просто используете нейросети в своей компании, получите рекомендации

Правовое регулирование в США

Общего закона об ИИ в США нет — каждый штат вводит правила и одновременно должен использовать существующие законы — например, если ИИ кого-то обманет, компанию привлекут по статьям о защите прав потребителей.

Некоторые примеры:

Работать на Америку с одним продуктом не получится. Придется либо делать отдельные версии под каждый штат, либо ориентироваться на самые строгие требования.

Правовое регулирование в Азии

Некоторые государства сделали ставку на комплексное законодательство об ИИ.

Правовое регулирование в Южной Корее

Закон об ИИ в Корее приняли в конце 2024 года и начали применять с января 2026.

Он требует:

-

маркировать ИИ-контент;

-

раскрывать информацию о применении нейросети;

-

оценивать риски и обеспечивать человеческий контроль в здравоохранении и финансовых решениях;

-

создавать национальные органы для координации.

Если работаете с корейскими пользователями — готовьте документы, логи и систему маркировки.

Правовое регулирование во Вьетнаме

Во Вьетнаме работа с искусственным интеллектом регулируется законом Law on Artificial Intelligence (Закон об искусственном интеллекте), который вступил в силу 1 марта 2026 года.

Основные положения:

- Классификация ИИ‑систем по уровням риска с разными требованиями к безопасности и контролю.

- Обязательное уведомление Министерства науки и технологий о средне- и высокорисковых системах перед запуском.

- Создание «песочниц» для тестирования, выдача субсидий и оказание других форм господдержки для стартапов и компаний.

- Обязательное вмешательство человека в решениях высокорисковых ИИ‑систем.

Правовое регулирование в Китае

Регулирование ИИ в Китае осуществляется в соответствии с законом об искусственном интеллекте, который вступил в силу с июля 2025 года. По нему нужно:

- регистрировать критические ИИ-системы;

- контролировать алгоритмы в публичном секторе;

- проводить аудит безопасности;

- соблюдать требования по защите данных;

- маркировать контент;

- создавать механизмы для обработки жалоб на услуги.

Китай — сложный рынок. Бизнесу стоит быть готовым к проверкам в любой момент и необходимости соблюдать полную прозрачность алгоритмов.

Правовое регулирование в России

В России нормативное поле формируется через целый ряд инициатив, стандартов и проектов. Рассмотрим, каких.

Законопроект о регулировании ИИ

В феврале 2026 года Министерство цифрового развития представило законопроект, который будет регламентировать работу ИИ. В законе об ИИ в России 2026 предлагается предусмотреть:

- критерии того, что считается российским ИИ;

- права, обязанности и ответственность участников рынка;

- маркировка ИИ-контента;

- особенности регулирования в медицине, безопасности, образовании.

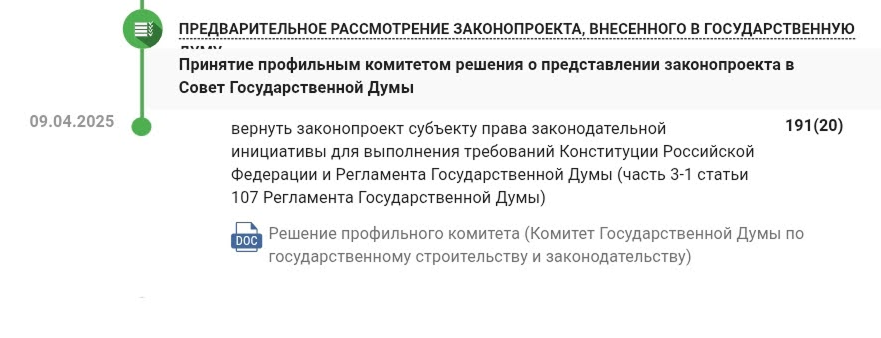

На данный момент законопроект не принят, его отправили на доработку

Стандарты и регламенты

1 марта 2026 года вступил в силу приказ Федеральной службы по техническому и экспортному контролю № 117. ИИ-системы должны охранять личные данные и не допускать утечек информации.

Также в России активно внедряют стандарты по ИИ по оценке качества и надежности систем, например, ГОСТ Р 59898‑2021, а также управляемости автоматизированными платформами, к примеру, ПНСТ 837‑2023. Кроме того, утвердили стандарты в ИИ в медицине:

- ГОСТ R 59921.11‑2025. Устанавливает, на каких данных учат ИИ, а также определяет, как проверять работу алгоритма.

- ГОСТ R 72313‑2025. Определяет, как собирать и проверять данные для ИИ, который ставит диагнозы.

Если не соблюдать эти требования, систему не сертифицируют и не разрешат применять. А если пострадает пациент, компанию привлекут к уголовной ответственности за ИИ.

Дополнительные инициативы и предложения

Различные ассоциации предлагают модели регулирования.

Ассоциация юристов России предложила законопроект, который запрещает использовать иностранные ИИ-сервисы в работе госорганов и на объектах критической инфраструктуры.

Планируется создать центр, который будет проверять, тестировать и сертифицировать отечественные ИИ-системы, разрабатывать стандарты безопасности и оценивать их надежность. По информации на февраль 2026 года, ведущим участником проекта может стать Институт системного программирования им. В. П. Иванникова РАН (ИСП РАН).

Все предложения находятся в стадии разработки и обсуждения. Точно говорить о требованиях можно будет только после того, как документы примут.

Международные инициативы в отношении ИИ

На международном уровне разрабатывают принципы и рекомендации по регулированию ИИ.

Framework Convention on Artificial Intelligence

(рамочная конвенция об искусственном интеллекте)

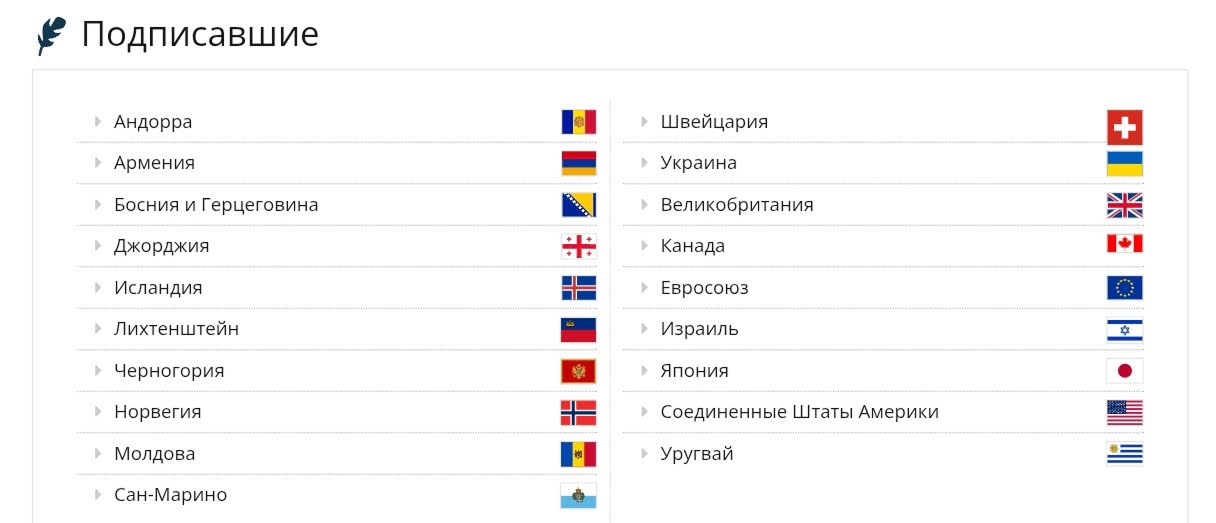

Конвенция, разработанная под эгидой Совета Европы 5 сентября 2024 года. Государства, которые присоединятся к нему, должны привести национальное регулирование в соответствии с требованиями документа.

Конвенция координирует весь жизненный цикл ИИ — от разработки до использования. Она устанавливает требования к прозрачности алгоритмов, защите прав граждан, запрету дискриминации, обязательной оценке рисков.

Документ вступит в силу после того, как каждая страна его ратифицирует и внедрит положения в местное законодательство.

Сейчас к конвенции присоединились 19 стран — России в их числе нет

Другие международные форматы

Существуют и другие международные форматы регулирования ИИ:

- Резолюция Генеральной Ассамблеи ООН A/RES/79/325. Учреждает структуры, которые будут вырабатывать рекомендации по безопасному использованию ИИ.

- Экспертные группы при ООН и ЮНЕСКО, к примеру, консультативный комитет по этике искусственного интеллекта и многосторонняя группа экспертов по ИИ. Они разрабатывают рекомендации, стандарты и методологии оценки рисков ИИ.

- Глобальные диалоги по управлению искусственного интеллекта под эгидой ООН. На этих дискуссиях страны договариваются, каким должен быть безопасный и этичный ИИ.

Другие методы регулирования работы ИИ

Даже в странах, где нет закона об искусственном интеллекте, нейросети подпадают под нормативные акты, которые регулируют их использование.

Законы об авторском праве и интеллектуальной собственности. Обычно, если контент создал ИИ, он может не признаться объектом авторского права. Но если человек внес творческий вклад, права закрепляются за ним. Нельзя использовать авторские материалы для обучения моделей.

Законы о защите персональных данных. При обучении и работе ИИ важно соблюдать правила обработки личной информации.

Законы о недискриминации и конкуренции. Решения ИИ не должны ущемлять права людей и нарушать антимонопольные правила.

Уголовное и гражданское законодательство. Если действия ИИ приведут к ущербу для людей или имущества, применяются нормы гражданского и уголовного права.

Если используете нейросеть в работе, вы подпадаете под обычные законы. Отговорка «это нейросеть виновата» в суде не сработает.

Что изменилось к 2026 году

Регулирование искусственного интеллекта вынуждает компании по-новому выстраивать процессы. Вот что меняется.

Растет стоимость внедрения ИИ в компании. Приходится соблюдать много законов одновременно. Из-за этого растут расходы: нужно нанимать юристов, выстраивать сложные системы контроля.

Раскалывается рынок. В разных странах предъявляют разные правила. Из-за этого выпустить один продукт для всего мира не получится — приходится делать отдельные версии под каждый рынок.

Увеличиваются требования к прозрачности и безопасности. Опасные нейросети важно проверять: оценивать риски и документировать решения. Это тормозит выпуск новых моделей — приходится подолгу все согласовывать и проверять.

Стимулируются локальные разработки. Там, где для иностранных компаний вводят жесткие правила, а своим дают поддержку, у местных компаний появляется пространство для роста.

Происходит сдвиг в сторону этики при использовании искусственного интеллекта. Забота об этике и соблюдении законов становится частью бизнес-стратегии. Если не соблюдать правила, последуют штрафы, суды и удар по репутации.

Появляются новые бизнес-модели. Отдельные компании и специалисты помогают другим проверять ИИ, дают «сертификаты безопасности» и учат, как не получить штраф.

Примеры судебных дел с ИИ

Во всем мире появляются судебные дела, которые связаны с использованием ИИ.

- Банк использовал робота-коллектора для автоматических звонков должникам.

Судья решил: если компания использует ИИ для общения с должником, и тот не понимает, что говорит с роботом, — на это нужно отдельное письменное согласие должника. Банк такого согласия не получил. - Продавец на маркетплейсе незаконно использовал авторское изображение.

В суде ответчик утверждал, что изображение сгенерировала нейросеть, и оно существенно отличается от первоисточника. Суд указал, что использование нейросети не освобождает от ответственности за нарушение авторских прав.

Судебные иски по ИИ могут подавать за что угодно — от интеллектуальных прав до морального ущерба. Даже если вы выиграете, суды отнимают время и деньги.

Рекомендации для компаний, которые используют ИИ

Используйте ИИ как помощника, но проверяйте все, что он делает. Придерживайтесь рекомендаций:

- Если загружаете в ИИ-сервис коммерческую информацию, персональные данные клиентов или внутренние документы — убедитесь, что это безопасно. Некоторые сервисы используют загруженное для обучения моделей.

- ИИ может ошибаться, выдумывать факты или давать опасные советы. Поэтому все проверяйте.

- Если используете сгенерированный контент в коммерческих целях, проверьте лицензию. Иногда права могут принадлежать платформе.

- Если чат-бот работает с клиентами, сообщайте им, что это не человек.

- Если ИИ принял решение, которое привело к проблемам, например, отказал клиенту или ошибся в расчетах, нужно понимать, почему так вышло. Сохраняйте историю использования.

- Если из-за ИИ пострадают люди, отвечать будете вы.

Заключение

К 2026 году регулирование ИИ сформировало разные рынки со своими правилами. В России внедрение законов находится в процессе: есть стандарты для медицины, защиты данных и запрет на иностранный ИИ в госсекторе. Для бизнеса это значит, что универсальных требований не существует. Важно подстраиваться под местные правила, а не надеяться на единый стандарт.